Research Progress of Computer Vision-Based Markerless Sports Motion Capture Technology

-

摘要:目的 近年来,针对运动动作的实时、精准和无标记识别成为备受关注的热点问题。系统回顾近年来国内外基于计算机视觉图像数据输入进行特定运动或目标动作的机器学习或深度学习识别相关研究,为无标记动作捕捉技术在运动动作识别等领域的应用提供参考。方法 通过布尔逻辑运算检索Web of Science、PubMed、Scopus、Google Scholar、IEEE Xplore、中国知网(CNKI)6个数据库收录的2000年1月—2020年6月发表的文献,分别对第一作者/发表年份、运动类型/目标动作、受试者信息、摄像机参数、图像特征提取技术、动作识别算法、动作识别质量评估方法、图像数据训练与验证方法、动作识别精度表现等关键信息进行提取。结果 筛选后共纳入23篇文献,39%的研究采用基于支持向量机的机器学习算法,35%的研究采用基于卷积神经网络的深度学习算法,其中分类精度、混淆矩阵和位移误差是大部分研究采用的动作识别质量评估方法。在动作技术识别和运动表现分析等领域,计算机视觉动作捕捉和相关模型、算法开发等已显示出良好的应用前景。支持向量机、主成分降维分析等传统机器学习算法仍是目前采用的主流动作识别技术,但随着卷积神经网络和循环神经网络等深度学习算法的开发与应用,在部分场景下的动作捕捉和识别效果优于传统的机器学习方法。结论 基于计算机视觉的场地摄像机设置、图像特征提取和动作识别算法模型开发需要结合特定的运动项目、应用场景和精度需求等进行多维度综合衡量。随着深度学习识别算法和可穿戴无线传感装备技术的发展,无标记动作捕捉的精确性、实时性和鲁棒性将得到进一步提升。Abstract:Objective In recent years, real-time, accurate, and markerless recognition of sports motions has been a hot issue. The related researches on machine learning or deep learning recognition of specific sports or target motions were systemetically reviewed based on computer vision data input and a reference was provided for the application of markerless motion capture technology in the field of sports science.Methods The documents published from January 2000 to June 2020 in 6 databases were collected, including Web of Science, PubMed, Scopus, Google Scholar, IEEE Xplore, and CNKI through Boolean logic operations. 23 research articles were included after screening, and the first author/year of publication, movement type/target action, subject information, camera parameters, image feature extraction technology, action recognition algorithm, action recognition quality evaluation method, image data training and verification methods, action recognition accuracy performance, and other key information were extracted.Results 39% of the studies use machine learning algorithms based on support vector machines, and 35% of the studies use deep learning algorithms based on convolutional neural networks. Classification accuracy, confusion matrix, and displacement error are the action recognition quality evaluation methods used in most studies.Conclusion Field camera settings based on computer vision, image feature extraction, and motion recognition algorithm model development need to be combined with specific sports, application scenarios, and accuracy requirements for multi-dimensional comprehensive measurement. With the development of deep learning recognition algorithms and wearable wireless sensing equipment, the accuracy, real-time, and robustness of unmarked motion capture will be further improved.

-

Keywords:

- computer vision /

- sports motion /

- markerless /

- motion capture /

- recognition technology

-

当前,动作捕捉系统(Motion Capture System,MoCap)及相关技术已广泛应用于运动科学、生物力学以及康复医学等领域[1-6]。例如,可穿戴的惯性传感测量元件(Inertial Measurement Unit,IMU)包含了加速度计、陀螺仪和磁强计传感器等组件,可以进行三轴测量,基于人体运动的分层结构,分别量化加速度、角速度和运动方向[7]。由于轻便、无线和便于操作等特性,其已被成功应用于足球、游泳、高山滑雪、跑步等项目的动作识别[8-11]。然而,在竞技比赛中,实验控制条件的受限以及禁止在体表粘贴标记点和佩戴传感器的要求提示上述动作捕捉技术存在劣势[12]。

近年来,基于计算机视觉的无标记动作捕捉技术使得复杂环境下的人体动作识别(human activity recognition)成为可能。通过摄像设备进行无标记动作捕捉,远程获取比赛中的运动学信息,依托计算机视觉的机器学习(machine learning)算法,将检测到的人体活动表示为与特定动作相对应的波信号特征并提取到计算机终端,进而同步完成视频的自动分析、信息的自动提取以及快速反馈[13-17]。基于计算机视觉图像的动作分析首先需要预测或估计目标在图像序列中的位置和方向,通过识别连续图像中具有相同或相近特征的目标,进而实现对位移参数的实时追踪和获取[18]。在当前实际应用中,通常将人体结构简化为由无摩擦的转动关节连接而成的一系列刚体,便于机器的识别与追踪[19],然而事实上人体运动十分复杂,并且由于肌肉、肌腱等软组织的存在,并不能以简单的刚体模型进行描述。因此,精准跟踪和量化动态的人体姿态成为当前计算机视觉、机器学习以及运动科学等领域专家所面临的难点之一[20-22]。

此外,传统的机器学习算法对原始运动学数据的处理能力有限,无法有效地对不连续、有噪声以及存在缺失值的高维数据进行训练[23-24],并且总是需要对原始数据进行预处理,包括卡尔曼滤波(Kalman Filter)、傅里叶快速变换(Fast Fourier Transform,FFT)以及包括主成分分析(Principal Component Analysis,PCA)和向量编码技术(vector coding techniques)的降维等一系列步骤[23, 25-28]。值得注意的是,与实验室环境下的三维动作捕捉分析相比,基于比赛现场的计算机视觉运动分析系统鲁棒性、准确性以及有效性的平衡依赖于算法的改良和硬件的优化[29]。近年来,结合深度学习(deep learning)算法进行人体姿态自动识别引起计算机视觉等领域专家学者的广泛关注[30]。

深度学习是机器学习的一个重要分支,其特点是具有更深层次的神经网络模型架构,其理念来源于人脑的生物神经网络[31]。该算法大多使用人工标记的图像数据来训练神经网络,随后将图像或视频输入经过训练后的网络,从而进行人体姿态、关节中心和骨骼位置的估计和识别[32]。与基于红、绿、蓝三原色(Red-Green-Blue,RGB)深度图像的微软Kinect摄像机相比,深度学习算法对摄像机与待测目标之间的距离及视频记录采样频率等约束较少[33-34]。当前,以深度学习为基础的方法已实现从二维RGB图像自动估计人体关节中心,并输出图像中的二维坐标[35]。同时,通过使用多台摄像机联动,同步多视角摄像机图像中的人体二维关节位置,并结合深度学习算法能够实现三维空间内对人体关节中心点和关键骨性标记点的定位[36]。基于人体三维姿态识别的深度学习计算机视觉研究正尝试使用一种算法进行姿势位置的估计和追踪,并且已有研究[37-38]探索了基于单目摄像机的三维人体姿态识别。

基于上述研究现状,本文通过系统回顾国内外基于计算机视觉的无标记动作捕捉技术,包括图像识别技术、机器学习算法以及深度学习算法在运动动作识别领域的应用现状,揭示无标记动作捕捉在运动检测和特征动作识别领域的潜在应用,如可实现日常训练比赛中运动员动作的无干扰识别与快速反馈,为教练员训练决策提供参考。

1. 研究方法

1.1 文献检索策略

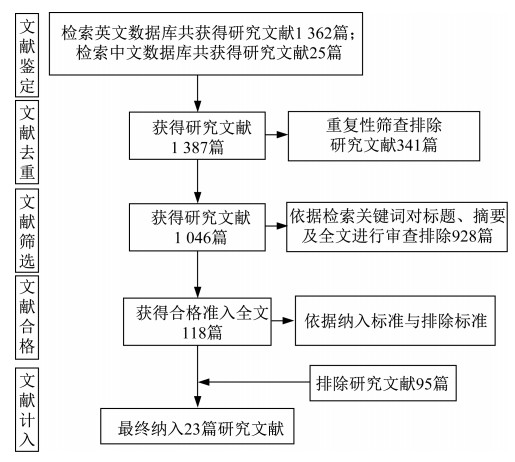

为确保纳入文献的全面性,本文的文献筛选过程依据系统评价和meta分析的PRISMA(Preferred Reporting Items for Systematic Reviews and Meta-Analysis)声明[39],对Web of Science、PubMed、Scopus、Google Scholar、IEEE Xplore、中国知网(CNKI)6个数据库进行文献检索。检索时间为2000年1月1日—2020年6月30日。检索中英文关键词运用“AND/OR”布尔运算符进行组合连接。英文检索词包括:(Sports OR Exercise OR Movement OR Motion OR Athlete OR Player OR Match OR Competition OR Game OR Training)AND(Movement OR Motor OR Action OR Skill)AND(Vision OR Computer Vision OR Machine Vision OR Camera OR Video OR Footage OR Motion)AND(Capture OR Recognition OR Detection OR Classification)。中文检索词包括:(运动OR运动员OR球员OR比赛OR竞赛OR训练)AND(运动动作OR移动OR行动OR技能)AND(视觉OR计算机视觉OR机器视觉OR摄像机OR视频OR镜头OR动作)AND(捕捉OR识别OR检测OR分类)。依据以上检索关键词依次对文献的标题、摘要进行筛选,随后提取文献全文进行评估。同时为避免遗漏,对检索文献的参考文献进行二次溯源检测。文献检索流程如图 1所示。

1.2 纳入/排除文献标准

纳入文献标准:①研究文献是公开发表的中文或英文论文;②研究聚焦具体的体育运动或动作,有计算机视觉输入作为模型训练数据库;③机器学习算法,数据处理过程定义清晰;④动作识别过程为半自动或全自动化。排除文献标准:①综述类论文;②研究不涉及具体的运动动作,或与临床或康复应用相关;③研究关注点为运动器材而非运动员本身;④数据处理过程和机器学习识别模型定义不明确。

1.3 研究信息筛选与提取

首先由2名作者分别对纳入文献的关键信息进行提取,使用Microsoft Excel 2016收集整理关键信息,不一致的信息由第3名作者综合评估判断。纳入文献关键信息包括第一作者、发表年份、运动类型/目标动作、样本量、受试者性别、运动员等级、摄像机数量、摄像机规格、采集频率、图像特征提取技术、动作识别技术、动作识别质量评估方法、图像数据训练与验证、动作识别精度表现14个指标。通过前期文献研究结果,发现受试者即采集对象的年龄对机器学习模型的识别精度几乎无影响,因此未将受试者年龄因素纳入考虑范围。动作识别技术包括将视频数据集转换为便于识别的预处理过程,以及将目标运动或动作进行分割的处理阶段(包括特征识别和提取技术,以及所采用的机器学习算法等)。

2. 研究结果

2.1 文献筛选结果

本文共检索到研究文献1 387篇,其中,通过Web of Science、PubMed、Scopus、Google Scholar、IEEE Xplore 5个英文数据库检索获得文献1 362篇,通过中国知网(CNKI)中文数据库检索获得文献25篇。统一导入文献管理软件Mendeley(2020)去重后得到1 046篇文献,由2名作者通过关键词、标题、摘要、全文进行独立审查,结合前文制定的纳入与排除标准进一步筛选剔除,最终纳入23篇文献,如图 1所示。

2.2 纳入文献实验设计

本文纳入研究文献均为基于计算机视觉的无标记动作捕捉技术,结合机器(深度)学习算法对多种运动项目及相关动作进行的识别和应用。在纳入的23篇文献中,涉及网球运动的有3项[40-42]、篮球运动的有3项[43-45]、体操运动的有2项[46-47]、拳击运动的有2项[48-49]、冰球运动的有2项[50-51]、高尔夫运动的有1项[52]、足球运动的有1项[53]、跳水运动的有1项[54]、排球运动的有1项[55]、空手道运动的有1项[56],1项研究同时包含游泳和网球运动[57],1项研究同时包含高尔夫和棒球运动[58],1项研究涉及步行、反向跳、掷球等基础动作[12],1项研究同时包含自行车和单板滑雪运动[59],1项研究涉及多种竞技运动组合,其数据集包含110万个经过标记的视频以及400余种不同的运动动作[60]。纳入研究多以职业运动员为研究对象(n=17),有16项研究报告了选取的运动员性别,其中14项研究[12, 42-45, 47-50, 52-53, 56, 58-59]的受试者仅为男性,1项研究[46]的受试者为女性,1项研究[41]同时包含男性和女性受试者。目前,无标记动作捕捉前处理环节较为主流的方法是针对目标运动特征进行分类处理,例如将网球运动分类为发球、正手击球和反手击球3类[40-42],将游泳运动按照泳姿分为蛙泳、仰泳、蝶泳和自由泳4类[57, 61]。基于深度学习算法的语义描述模型,能够实现对运动员训练动作、技术水平及疲劳程度的分类和预测,例如对体操鞍马旋转动作的分类等[47]。

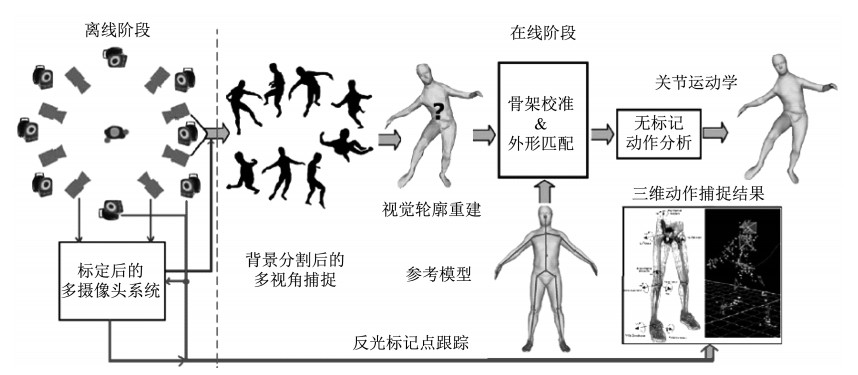

2.3 计算机视觉图像获取途径

本文选取的23项研究包含了多种不同的实验设计及计算机视觉图像获取方式,如表 1所示。传统的基于反光标记追踪的红外三维动作捕捉与基于计算机视觉的无标记动作捕捉流程如图 2所示。有16项研究[12, 40-44, 46, 50, 52-54, 56-59, 61]的计算机视觉图像采集依靠主流的RGB摄像机进行,3项研究[47-49]采用深度摄像头对竞技运动场的三维图像进行深度感知和获取,此外还有4项研究[45, 51, 55, 60]的摄像头类型未给出。从摄像头数量以及设置的角度看,10项研究[43-44, 46-49, 52, 54, 56, 58]采用单目镜头完成全部图像的采集和获取,其中3项使用深度摄像头的研究[47-49]均使用单目镜头。1项研究[53]采用了16个环绕足球场的RGB摄像头,以“鸟瞰(bird's eye view)”视角对全场运动图像进行采集。此外,共有11项研究[12, 43, 46, 48-49, 52-53, 56-59]报道了摄像机的采集频率,从25帧/s到210帧/s不等。O′Conaire等[42]使用1个俯视镜头及8个围绕网球场边线的镜头对运动员的发球、正手击球和反手击球动作进行识别,但由于障碍遮挡等因素,仅有2个摄像头捕捉的图像可用于最终的动作识别分析。

表 1 基于计算机视觉的无标记动作捕捉相关研究关键信息提取(N=23)Table 1. Extraction of key information related to studies on vision-based markerless motion capture studies (N=23)作者(发表年份) 运动类型/目标动作 受试者信息 摄像机参数 图像特征提取技术 动作识别技术 动作识别质量评估方法 图像数据训练与验证 动作识别精度 样本量 性别 运动员等级 数量 规格 采集频率 Nakano等[12](2020) ①步行

②反向跳

③掷球2 M NR 5 RGB ①1K分辨率,120帧/s

②4K分辨率,

30帧/s①对比基于OpenPose的无标记动作捕捉和基于传统标记的动作捕捉识别关节位置的精确度

②每帧图像提取25个身体关键标记点

③直接线性变换(DLT)将二维图像坐标转换为三维空间坐标卷积神经网络(CNN)

k-近邻算法(kNN)位移误差 NR 47% < 20 mm

80% < 30 mm

10% > 40 mmLi等[58] (2018) ①高尔夫、棒球

②关键挥杆动作高尔夫:1 343;

棒球:3 363M 职业运动员 1 RGB 30帧/s ①高尔夫挥杆动作前面观

②高尔夫挥杆动作侧面观

③棒球挥杆动作支持向量机(SVM) ①分类精度(CA)

②计算耗时①交叉验证

②80%训练集,10%验证集,10%测试集①分类精度为97%

②平均计算耗时为2.38 msBertasius等[43] (2017) ①篮球

②投篮

动作48 M 美国NCAA联赛职业运动员 1 RGB 100帧/s 10.3 h视频 ①卷积神经网络(CNN)

②循环神经网络(RNN)、长短期记忆(LSTM)F1得分 ①训练数据集:24个视频

②测试数据集:24个视频①篮球特征识别F1得分为0.625

②篮球运动员表现评价模型F1得分为0.793Kasiri等[48] (2017) ①拳击

②6种类型的直拳、勾拳、摆拳14 M 不同重量级的职业拳击手 1 5 m高, 深度摄像头 25帧/s ①605次出拳

②身体部位检测:基于二维倒角距离、深度值和测地线距离的模糊推理方法①主成分分析(PCA)

②随机森林(RF)

③支持向量机(SVM)①混淆矩阵(CM)

②分类精度(CA)留一法交叉验证(LOO-CV) ①分类精度为63.9%

②融合模型分类精度为60.9%Liu等[44] (2017) ①篮球

②智能篮球场视频分析

③投篮动作10 M 业余运动员 1 RGB NR ①476个投篮得分视频

②571个投篮未得分视频①卷积神经网络(CNN)

②隐马尔科夫模型(HMM)

③支持向量机(SVM)分类精度(CA) ①862个视频作为训练集

②185个视频作为测试集处理时间小于45 ms,分类精度达到94.59% Nibali等[54] (2017) ①跳水

②翻转、团身、扭转、倒立入水等动作NR NR 澳大利亚体育学院高水平运动员 1 RGB NR ①训练集:25 h共4 716次跳水动作

②测试集:同一天内的612次跳水动作

③空间定位:完全回归、部分回归、分段和全局约束卷积神经网络(CNN) 分类精度(CA) NR 跳水动作分类精度范围为86.89%~100% Reily等[47] (2017) ①体操

②鞍马常规旋转动作NR M 职业运动员 1 深度摄像头 NR ①10 115帧PNG格式图片

②通过特征描述:轮廓高度和宽度;轮廓两侧的深度值;与前一帧图像的三维坐标对比支持向量机(SVM) 分类精度(CA) NR ①旋转动作分类精度为93.81%

②平滑处理后旋转动作分类精度提升为94.83%Tora等[51] (2017) ①冰球

②传球、射门NR NR 职业运动员 NR NR NR ①美国冰球联盟比赛视频

②2 507个训练视频

③250个测试视频卷积神经网络(CNN) ①分类精度(CA)

②混淆矩阵(CM)NR 总体分类精度为49.2% Victor等[57] (2017) ①游泳、网球

②仰泳、蛙泳、蝶泳、自由泳4种泳姿

③网球击球动作游泳:40

网球:4NR 职业运动员 NR RGB 游泳:50帧/s

网球:30帧/s①1.5万次游泳划水动作视频

②1 300次网球击球动作视频基于VGG-B架构的卷积神经网络(CNN) F1得分 ①80%训练数据集

②20%测试数据集①游泳F1得分为0.922

②网球F1得分为0.977Ibrahim等[55] (2016) ①排球

②6堂团体训练课

③7名运动员个人动作捕捉NR NR 职业运动员 NR NR NR ①15个YouTube排球训练视频

②1 525帧带注解的图像①卷积神经网络(CNN)

②循环神经网络(RNN)、长短期记忆(LSTM)①分类精度(CA)

②混淆矩阵(CM)①2/3数据作为训练集

②1/3数据作为测试集分类精度为51.1% Ramanathan等[45] (2016) ①篮球

②11场篮球比赛,关键运动员检测NR M 美国NCAA篮球联赛职业运动员 NR NR NR ①257个YouTube篮球比赛视频

②训练集视频4 572 s

③验证集视频3 424 s

④测试集视频9 024 s循环神经网络(RNN),包括长短期记忆(LSTM)和双向长短期记忆(BLSTM) 分类精度(CA) 通过在验证数据集上进行交叉验证选择超参数(hyper-parameters) ①事件平均分类精度为51.6%

②事件检测分类精度为43.5%

③运动员识别分类精度为61.8%Kasiri-Bidhendi等[49] (2015) ①拳击

②6种类型的直拳、勾拳、摆拳8 M 职业拳击手 1 5 m高,深度摄像头 25帧/s ①共192次出拳

②每种类型的出拳为32次

③身体部位识别:基于二维倒角距离和测地线距离的模糊推理方法

④提取每次出拳的时空参数特征①随机森林(RF)

②支持向量机(SVM)①分类精度(CA)

②混淆矩阵(CM)①7名受试者作为训练集

②1名受试者作为测试集

③留一法交叉验证(LOO-CV)分类精度为92%~96% Hachaj等[56](2015) ①空手道

②10种动作:4种防御类,3种踢腿类,3种站立类6 M 顶尖运动员 1 RGB 30帧/s 对1 236次空手道相关动作进行关节角度识别 隐马尔可夫模型(HMM) ①分类精度(CA)

②混淆矩阵(CM)留一法交叉验证(LOO-CV) 总体分类精度为93% Montoliu等[53] (2015) ①足球

②包括控球、定位球和快速进攻NR M 西班牙职业足球运动员 16 RGB 25帧/s ①2场全场足球比赛

②所有图像通过算法组合覆盖足球全场①k-近邻算法(kNN)

②多层感知器算法(MLP)分类精度(CA) ①留一法交叉验证(LOO-CV)

②5层交叉验证分类精度为92.89%±0.2% Díaz⁃Pereira等[46] (2014) ①体操

②10个动作,分为跳跃、旋转、技巧8 F 青少年运动员 1 RGB 25帧/s 560个视频 ①主成分分析(PCA)

②线性判别分析(LDA)

③k-近邻算法(kNN)①灵敏度

②特征识别度10层交叉验证 ①总体灵敏度为90%

②总体特征识别度为85%Karpathy等[60] (2014) 多种竞技运动组合 NR NR 职业运动员 NR NR NR ①110万个YouTube源视频

②随机抽样170×170个视频区域

③每个视频区域包含200×200个像素卷积神经网络(CNN) ①分类精度(CA)

②混淆矩阵(CM)①70%数据作为训练集

②10%数据作为验证集

③20%数据作为测试集分类精度为60.9% Couceiro等[52] (2013) ①高尔夫

②运动员推杆动作6 M 职业运动员 1 RGB 210帧/s ①180次推杆动作

②每名运动员30次①达尔文粒子群优化方法(DPSOM)

②线性判别分析(LDA)混淆矩阵(CM) NR 最小二乘支持向量机(LS-SVM) 总体表现最佳 O′Conaire等[42] (2010) ①网球

②发球、正手击球和反手击球动作5 M 职业运动员 9 RGB NR 基于背景减影和图像形态提取运动员轮廓特征 ①支持向量机(SVM)

②k-近邻算法(kNN)分类精度(CA) 留一法交叉验证(LOO-CV) ①后面观分类精度为98.67%

②侧面观分类精度为95%Lu等[50](2009) ①冰球

②各个方向滑冰运动NR M NR NR RGB NR 5 069张32×32的灰度图像

结合主成分降维分析的多目标跟踪主成分分析(PCA) ①分类精度(CA)

②平均计算耗时

③混淆矩阵(CM)NR ①分类精度为76.37%

②图像识别平均耗时0.206 sRosenhahn等[59] (2008) ①自行车

②单板滑雪

③运动员与装备交互的建模和无标记跟踪2 M NR 7 RGB 100帧/s ①室内功率自行车足部固定骑行

②虚拟现实技术模拟单板滑雪上坡、下坡及跳跃动作支持向量机(SVM) 位移误差 NR 位移误差小于5 mm Shah等[41] (2007) ①网球

②正手击球、反手

击球NR M/F NR NR RGB NR ①150场网球比赛

②每场比赛压缩为

10 min

③采用全局自适应阈值法进行图像分割和权值计算

④基于二进制图像的运动员骨架直方图基于径向基函数的支持向量机(SVM) ①分类精度(CA)

②混淆矩阵(CM)NR ①正手击球分类精度为97.24%

②反手击球分类精度为96.42%Zhu等 [40] (2006) ①网球

②正手击球、反手

击球NR NR 职业运动员 NR RGB NR ①6 035帧图像

②1 099次左侧击球,

1 071次右侧击球

③采用粒子滤波和支持向量回归算法进行运动员追踪识别支持向量机(SVM) ①精确度

②再测精度NR ①左侧击球捕捉精确度为89.80%

②右侧击球捕捉精确度为84.66%

③左侧击球再测精度为84.08%

④右侧击球再测精度为90.20%Liao等[61] (2003) ①游泳

②自由泳、蝶泳、蛙泳、仰泳NR NR 职业运动员 NR RGB NR ①50个比赛视频

②采用启发式阈值分割方法识别运动员上半身动作逻辑回归分析(LR)

决策树(DT)基于特定泳姿开发的评分系统 NR NR 注:RGB(Red,Green,Blue)=三原色光模式;帧/s=每秒传输帧数;PNG(Portable Network Graphics)=便携式网络图形;LSTM(Long Short Term Memory)=长短期记忆;CNN(Convolutional Neural Network)=卷积神经网络;kNN(k-Nearest Neighbour)=k-近邻算法;RNN(Recurrent Neural Network)=循环神经网络;HMM(Hidden Markov Model)=隐马尔科夫模型;LOO-CV(Leave-One-Out Cross Validation)=留一法交叉验证;SVM(Support Vector Machine)=支持向量机;LS-SVM(Least Squares Support Vector Machine)=最小二乘支持向量机;RF(Random Forests)=随机森林算法;ROC(Receiver Operation Characteristic Curve)=接收者操作特征曲线;DPSOM(Darwinian Particle Swarm Optimization Method)=达尔文粒子群优化算法;LR(Logistic Regression)=逻辑回归分析;MLP(Multilayer Perceptron)=多层感知器;CA(Classification Accuracy)=分类精度;CM(Confusion Matrix)=混淆矩阵;M(Male)=男,F(Femal)=女,NR(Not Reported)=未报告。 ![]() 图 2 无标记计算机视觉轮廓动作捕捉与反光标记红外三维动作捕捉流程[62]Figure 2. The markerless computer vision motion capture and the marker-based infrared three-dimensional motion capture

图 2 无标记计算机视觉轮廓动作捕捉与反光标记红外三维动作捕捉流程[62]Figure 2. The markerless computer vision motion capture and the marker-based infrared three-dimensional motion capture2.4 图像特征提取与动作识别技术

基于机器学习和深度学习算法的计算机视觉捕捉图像特征提取是本文涉及的23项研究采用的主流方法,主要体现在二维图像的转换以及输入图像数据的分割等处理步骤。纳入研究均报道了图像特征提取采用的关键算法和技术,其中单纯使用机器学习算法的研究[40-42, 46-50, 52-53, 56, 58-59, 61]有14项,仅借助深度学习算法的研究[43, 45, 51, 54-55, 57, 60]有7项,同时结合机器学习和深度学习算法的研究[12, 44]有2项。

纳入文献中共有9项研究[40-42, 44, 47-49, 58-59]采用支持向量机(Support Vector Machine,SVM)相关算法,其中:2006—2008、2012、2015、2018年各1项,2017年3项,共占所有研究的39%;2009、2013、2014、2017年共有4项研究[46, 48, 50, 52]采用基于机器学习的降维算法,其中包括主成分分析和线性判别分析(Linear Discriminant Analysis,LDA);2010、2014、2015、2019年共有4项研究[12, 42, 46, 53]采用k-近邻算法(k-Nearest Neighbour,kNN);2015和2017年共有2项研究[44, 56]采用隐马尔科夫模型(Hidden Markov Model,HMM)相关算法,另有2项研究[48-49]采用随机森林(Random Forest,RF)算法;2003年有2项研究,其中1项采用逻辑回归分析算法(Logistic Regression,LR)相关算法[61],另外1项采用决策树(Decision Tree,DT)算法[61];2015年有1项研究[53]采用多层感知(Multilayer Perceptron,MLP)算法,2013年有1项研究[52]采用达尔文粒子群优化方法(Darwinian Particle Swarm Optimization Method,DPSOM)。在所有使用深度学习相关算法的研究中,采用卷积神经网络(Convolutional Neural Network,CNN)相关算法的研究[12, 43-44, 51, 54-55, 57, 60]有8项,其中仅2017年就有5项,另外3项研究分别发表于2014、2016、2019年;此外,2015、2016、2017年有3项研究[43, 45, 55]采用了循环神经网络(Recurrent Neural Network,RNN)相关算法。

2.5 动作识别质量评估与精度表现

如表 1所示,基于计算机视觉的动作识别质量评估方法大部分采用定量评估,其中采用分类精度方法(Classification Accuracy,CA)进行评估的研究[41-42, 44-45, 47-51, 53, 55-56, 58, 60]有14项,占所有研究的65%。从识别精度表现角度评估,分类精度值越接近100%,说明动作识别精度越高。纳入研究的分类精度范围为49.2%~100%,其中分类精度值范围小于80%的研究[45, 48, 50-51, 55, 60]有6项,分类精度值范围在90%~100%的研究[41-42, 44, 47, 49, 53, 56, 58]有8项,有1项研究[54]的分类精度值范围在80%~100%。采用混淆矩阵(Confusion Matrix,CM)对模型动作识别结果进行可视化的研究[41, 48-52, 55-56, 60]有9项。有2项研究[43, 57]采用F1得分来判断动作识别算法的精确度,研究的目标运动为篮球,以及游泳和网球。2项研究[12, 59]采用位移误差评估识别精度,其中:1项研究的动作识别位移误差小于5 mm;另1项研究基于OpenPose开源人体姿态估计算法的无标记动作捕捉,80%的位移误差在30 mm以下,但有10%的位移误差在40 mm以上,识别精度较为局限。

3. 讨论

随着计算机技术、图像识别处理技术以及人工智能等相关算法的发展进步,全自动、实时、无标记的动作捕捉应是未来运动科学领域进行动作识别和动作技术分析的主流方式。相比于传统的实验室运动学测量分析,无标记动作捕捉技术的优势[15]:一方面能够摆脱场地等限制因素,降低测试前准备工作量;另一方面能够大大提升动作捕捉的效率,做到实时反馈甚至超前预判,为教练员的训练决策和运动员场上动作技术改进提供依据。目前,基于计算机视觉的无标记动作捕捉在竞技体育和运动科学领域的应用较少,相关识别技术、算法有待进一步开发,同时系统的鲁棒性、准确性、灵敏性也需要进一步验证。传统的基于红外摄像机的三维动作捕捉系统仅需要识别粘贴在受试者体表骨性标志的反光点,随后基于追踪的标记点三维坐标构建人体骨架模型。然而,在无标记动作捕捉领域,就需要借助相关的机器学习算法识别人体动作,构建人体运动学模型,完成连续图像中的运动学参数获取[17]。基于计算机视觉的无标记动作捕捉系统主要由4个组成部分:①摄像机系统;②人体图像识别模型构建;③图像特征提取;④机器学习识别算法的应用。在以上4个部分中,图像参数的捕捉和获取是离线(off-line)处理部分,图像特征提取、识别模型构建以及算法应用是在线(on-line)处理部分,机器学习识别算法的优化通常需要大量的图像数据训练以提升识别效果。下文结合计算机视觉无标记动作捕捉系统的4个组成部分以及动作捕捉精度进行具体分析,并提出当前无标记动作捕捉技术的局限性和未来研究方向。

3.1 运动图像捕捉及模型构建

本文纳入的研究多数采用单目RGB摄像机配置。与多个摄像机相比,单个摄像机输出的数据可以最大限度地减少需要处理的数据量,降低计算工作量。然而,由于遮挡和视角变化,单摄像机在细节特征捕捉以及多个体参与的团队竞赛中存在局限性,但多摄像机配置会增加处理时间和模型计算的复杂程度[63]。因此,需要对计算量和运动捕捉的精度进行有效平衡,使摄像头的放置位置和数量适应运动目标的生物力学特征及捕捉环境。本文纳入的研究大多是基于运动现场的实时动作捕捉,即需要快速反馈,因此使用便携式的单目RGB摄像头易于在动态环境中捕捉运动图像,节省校准和标定耗时。当前,用于图像捕捉的摄像机主要包含2种类型:①传统的识别图像颜色、亮度等特征的RGB摄像机;②能够识别图像中每个像素点到摄像头距离的深度摄像机[64]。相比于传统摄像机,深度摄像机受光线、阴影、反射和复杂背景的影响较小。可以同时获取图像颜色和深度值的RGB-D传感相机系统通过光线传输时间(Time of Fight,ToF)技术,采用红外线作为光源,记录光源强度信息以及光线从光源到图像中像素点的时间,能够对人体全身的三维姿态进行有效估计。目前该技术已应用在微软Kinect人机交互系统,能够感知三维环境中的人体姿态[65]。当前已有研究比较基于ToF技术的深度相机和基于反光标记的动作捕捉系统识别人体下蹲动作的运动学参数,但需要注意的是,深度相机较低的采集频率(通常为30帧/s以下)和对自然光线高度的敏感性以及多深度传感器之间的干扰可能会限制其在运动科学中的应用[64]。

无标记动作捕捉建立的人体模型与基于反光标记三维动作捕捉建立的人体骨架模型类似,均是由骨骼以及相邻骨骼组成的关节构成,通常采用骨骼长度、关节相对位移以及关节角度等指标量化模型特征[66]。基于无标记动作捕捉的人体模型构建通常需要识别图像中人体的轮廓和体积特征,再通过进一步的算法提取人体模型中的关节运动轨迹等运动学参数[67]。早期研究通常采用简化的圆柱几何形状近似表示人体模型的轮廓和体积特征,该模型以人体骨架为基础,在已知四肢长度和人体姿态的前提下,可以通过空间三维高斯函数(Spatial 3D Gaussians)排列简化的立体几何形态,将体积参数赋予骨架模型,从而生成人体模型轮廓[68]。这种识别模型仍然有其应用的场景,原因是该模型仅需要提取相对简单的图像特征,实现对人体位置快速和近实时拟合,但缺点是拟合精度有限,难以在精确定量的运动分析中应用[69]。目前,三维统计形状模型(3D Statistical Shape Model)方法已被应用于人体建模,该方法通过识别图像中的关键点,结合形状对齐、相似变换(similarity transformation)、主成分分析降维处理等操作步骤,使用数量较少的二维参数拟合图像中的人体形态[70-71]。但由于统计形状模型方法聚焦的重点是人体模型的表层形态,对模型底层的骨架结构能否实现精确模拟还需要进一步验证。现阶段基于计算机视觉的无标记动作捕捉大多构建的是简化后的人体参数模型,识别的有效性和准确度在很大程度上取决于识别算法的质量[72-73]。

3.2 基于计算机视觉的图像特征

数字图像由二维数字网格排列而成,其中每个网格中的数字代表该网格的颜色与亮度,即像素。确定像素与物体之间的关系是计算机视觉的一项根本任务,如何提取图像中的人体运动特征是实现无标记动作捕捉的核心环节和技术难点,而基于标记点的动作捕捉不存在图像特征提取和识别的问题[74]。无标记动作捕捉的首要任务是确定图像的范围和捕捉目标的位置。传统的捕捉目标提取和图像背景分割通常采用色度差分法,该方法将图像背景预涂为特定颜色,要求被捕捉目标使用色差较大的对比色,即可将目标轮廓从图像中快速分割出来[63]。对于图像背景复杂,无法使用色度差分法的情况,则可以使用背景减除算法,但该方法较容易受到阴影、反射、遮挡、光线变化以及捕捉目标之间的相互影响。图像轮廓的模糊为特征识别增加了难度,仅通过轮廓特征无法提供被观察对象与摄像机的距离参数、相对位置以及朝向等信息,可以通过增加摄像机数量,使用更为复杂的图像轮廓特征识别算法降低处理过程的模糊性[75]。

在摄像机数量充足的前提下,可以通过不同角度的图像轮廓拟合,实现捕捉目标的三维形态转换,获得图像轮廓视觉外壳(visual hull)[76]。该方法对多台摄像机的观察目标进行三维轮廓重建,基于不同方向角度捕捉到的二维图像,结合每台摄像机捕捉的视锥区域交点,形成三维的图像轮廓视觉外壳[75]。捕捉目标三维建模精确度和复杂程度的提升会导致运算时长和算法复杂程度增加。需要注意的是,图像轮廓的三维重建不能解决所有的图像拟合问题,还需要结合额外的信息输入以识别图像轮廓的位置与身体各环节的对应关系[29]。捕捉目标的轮廓识别是无标记动作捕捉的重要组成部分,Liu等[77]基于1台RGB摄像机对篮球投篮动作进行图像轮廓解析,相较于基于标记点的动作捕捉,图像分类精度达到了94.59%,实现了较为精确的图像轮廓识别,并且可进行多目标跟踪。使用图像轮廓识别技术可以提高鲁棒性,降低识别目标模糊程度,减少摄像机的使用数量并简化无标记动作捕捉流程。随着深度学习算法的应用,图像识别过程将得到进一步简化,使用单机位进行被捕捉目标的三维动作识别成为可能[78]。

3.3 基于机器学习的识别算法

用于识别图像中人体姿态的机器学习算法可以分为生成式算法(generative algorithm)和判别式算法(discriminative algorithm),统称为监督式学习[79]。监督式学习算法在基于计算机视觉的无标记动作识别领域占主导地位,训练数据集的生成首先需要对视频进行手动标记和注释等前处理过程,如果是由多摄像机跟踪的多目标运动,前处理难度会显著增加。例如,Victor等[57]对高达15 000个游泳和网球视频进行了手动标记,耗时较长,工作量较大。生成式算法对基于训练数据的学习进行预测,模型参数可以根据图像数据生成假设,随后对该假设进行评估,通过进一步的迭代优化,从而确定最佳的预测匹配[80-81]。生成式算法包括朴素贝叶斯算法(naive Bayes)、隐马尔可夫算法、k-近邻算法等[82]。判别式算法直接使用图像数据推断模型参数,避免了反复调整人体模型参数适应图像的过程,因此也被称为无模型算法。与生成式算法相比,判别式算法处理时间较短,对异常值判别的鲁棒性更高。常用的判别式算法包括逻辑回归、支持向量机、决策树、线性判别分析、神经网络(Neural Network,NN)等[83]。

在基于生成式算法的无标记动作识别中,人体的姿势形态是通过将人体模型与从图像中提取的信息进行匹配确定的。例如,对于一组给定的模型参数(身体形状、骨骼长度、关节角度等),首先可以生成对应的模型预测参数,随后将预测参数与图像提取特征进行比较,从而计算单个“误差值”,该“误差值”可以表示假设值与观测值的差异程度[84]。有研究[75, 85]将预测得到的三维网格投影到二维图像中,调整网格与捕捉目标轮廓重叠程度最大化,通过迭代最近点算法(Iterative Closest Point,ICP)可以实现图像视觉外壳与捕捉目标各顶点的匹配度对比。生成式算法的关键是对算法函数的准确定义,从而将特定假设与图像信息进行比对,如果算法函数失准,则无法实现最优模型参数的匹配,导致运动约束降低和出现异常值的概率增加[86]。构建针对较高图像噪声和较低模型配置的高鲁棒性算法函数较为困难,一方面由于生成式算法需要对模型参数进行合理可靠的初始推测,另一方面被捕捉目标需要在开始阶段以特定的姿势进行初始标定[87]。在没有人为干预的情况下,由于遮挡、图像噪声或其他因素导致的精度下降,算法函数是无法进行自我纠正和还原的。前期已有研究[88]尝试改进相关算法函数,或通过结合生成式算法和判别式算法来解决这一难点。当前,无标记动作识别主要通过机器学习算法实现,但该文纳入的9项研究采用了深度学习算法,其中基于卷积神经网络(CNN)算法的总体计算用时最短,在相同硬件条件下的计算量更少,因此被其中的8项研究所采用。作为判别式算法的主要组成部分,深度学习将随着硬件设施的提升、数据量的扩大而得到越来越多的应用[31, 89]。

3.4 无标记动作捕捉精度

无标记动作捕捉的精度表现可以通过可视化的模型预测结果与真实测量结果之间的比较进行量化,其中分类精度是最常使用的量化方法,其次是混淆矩阵。上述方法能够较为清晰地呈现模型预测结果与实测结果之间的差异,从而呈现模型预测精度。后续测量包括模型灵敏度、精确度和再测精度,测量结果越接近1.0表明模型预测精度越高,效果越好[17]。F1得分(F1-Score)也称F测量,是推导模型预测精度和灵敏度之间平衡性能的重要指标,可以对人体运动识别表现进行深入分析。具体的模型精度预测方法和算法的使用需要根据数据类型,传统的误差率或错误率统计方法一般使用默认的决策阈值,因此并不适用基于复杂的训练数据集开发的模型[90-91]。分类模型评估方法还包括接收者操作特征曲线(Receiver Operating Characteristic Curve,ROC),曲线下的包络面积是ROC的重要特征,面积越接近1表示模型识别能力越强[92]。每种研究方法都有其特定的参数设置、特征向量和模型训练算法,因此,评估不同研究方法的合理性和有效性是较为复杂的。Wolpert[93]在1996年提出的“无免费午餐定理(No-Free-Lunch theorems)”,即NFL定理是机器学习及搜索优化算法的重要理论基石,该定理指出,不存在单一的或通用的机器学习算法去解决和优化所有的识别问题。因此,建议针对某一特定问题和数据集采用组合方法,输入任务的先验假设(prior assumption)来适应模型输入和相关参数,以提高模型预测的整体成功率[94]。

本文纳入的大多数研究是基于运动场的实时无标记动作捕捉和运动员特定动作参数获取的,包括执行动作的数量、类型和强度等特征统计,可以应用于运动负荷监控、运动员个性化动作技术分析、自动化打分评估系统开发和团体球类运动的传球投篮动作质量评估等领域[47, 95]。对于足球、橄榄球等室外运动,由于动作本身的复杂性和环境干扰,个体化模型的一致性和跟踪精度是当前面临的主要挑战。例如,足球射门和传球动作的分类精度在封闭的实验室环境要高于室外足球场环境[96]。摄像机摆放位置和视频分辨率对无标记动作捕捉精度同样有较大影响。Corazza等[75]使用高分辨率摄像机并调整摄像机位置后,关节中心点位移误差从调整前的(79±12)mm降低至(15±10)mm。现有研究[45, 51, 55]显示,基于计算机视觉的深度学习算法在篮球、排球和冰球等团体球类项目中具有较为稳定的捕捉精度表现,预测模型的计算效率、结果精度和复杂程度之间的平衡也是需要考虑的重要因素。

3.5 研究局限与未来展望

在本文纳入的23项研究中,由于选取的模型参数和评估方法等差异,研究之间异质性较大,无法进行定量的荟萃分析。纳入研究的动作识别技术限定在机器学习以及深度学习算法领域,未考虑其他算法,例如线性判别函数分析等。此外,运动项目的不同以及运动场地大小的差异也可能是影响技术选择的重要因素,但由于纳入文献数量的限制及侧重点不同,本文并未对其进行进一步归纳分析。无标记动作捕捉系统的精确度和鲁棒性往往取决于研究领域和特定的采集环境,在不同领域的应用方式是不统一的。运动生物力学和康复医学等领域要求无标记运动分析系统具有高度精确性和较强适应性以检测运动过程中的细微变化[15]。基于上述部分应用场景对无标记动作捕捉系统的准确性和稳定性等方面需求,Elhayek等[78]提出将鲁棒性较高的判别分析方法与无轮廓运动学模型拟合方法相融合,以提升精度表现。当前,跑步运动的无标记动作捕捉可以实现步长、步频等时空参数的精确捕捉,并实现实时反馈[67]。三维关节角度等较为复杂的运动学参数需要对跟踪对象进行建模和在线捕捉采集,随后进行一定时间的离线处理,较难实现实时反馈。上述无标记动作捕捉过程,不需要对受试者、环境等进行特殊准备和标定等前处理,实现了训练实践和运动科学研究的同步,快速实时的反馈为教练员训练方案选取和运动员动作技术优化提供依据。但是,摄像机分辨率和捕捉精度需求的提升将导致视频存储和参数处理工作量大大增加,因此需要进行有效平衡,增加无标记动作捕捉的可操作性和实用价值。

4. 结论与启示

(1)本文对机器学习、深度学习和相关算法技术在基于计算机视觉的无标记动作捕捉系统中的应用研究进行归纳综述,在动作技术识别和运动表现分析等领域,计算机视觉动作捕捉和相关模型、算法开发等已显示出良好的应用前景。其中支持向量机、主成分降维分析等传统机器学习算法仍是目前采用的主流动作识别技术。但随着卷积神经网络和循环神经网络等深度学习算法的开发与应用,在部分场景下的动作捕捉和识别效果要优于传统的机器学习方法。

(2)计算机视觉识别装置,包括常规的RGB摄像机和深度摄像机,其位置的摆放和设置、镜头分辨率、识别算法的选取以及数据存储处理等过程需要结合具体的运动场景(室内/室外/规模)、捕捉对象(单人/多人)和目标运动特点。室外运动和多目标运动项目容易受到捕捉环境、设备仪器和识别算法等的限制,因此,目前要实现对运动员动作的精确捕捉和实时反馈仍具有一定的挑战性。

(3)未来研究可以针对特定运动动作识别和运动表现评估,将传统的机器学习算法与深度学习识别算法进行对比,从而为动作识别技术和相关算法的选取与融合应用提供依据。计算机视觉图像可以与可穿戴无线惯性传感等装置配合使用,实现运动过程的多参数联合采集,提升无标记动作识别的效果、效率和鲁棒性。

-

图 2 无标记计算机视觉轮廓动作捕捉与反光标记红外三维动作捕捉流程[62]

Figure 2. The markerless computer vision motion capture and the marker-based infrared three-dimensional motion capture

表 1 基于计算机视觉的无标记动作捕捉相关研究关键信息提取(N=23)

Table 1 Extraction of key information related to studies on vision-based markerless motion capture studies (N=23)

作者(发表年份) 运动类型/目标动作 受试者信息 摄像机参数 图像特征提取技术 动作识别技术 动作识别质量评估方法 图像数据训练与验证 动作识别精度 样本量 性别 运动员等级 数量 规格 采集频率 Nakano等[12](2020) ①步行

②反向跳

③掷球2 M NR 5 RGB ①1K分辨率,120帧/s

②4K分辨率,

30帧/s①对比基于OpenPose的无标记动作捕捉和基于传统标记的动作捕捉识别关节位置的精确度

②每帧图像提取25个身体关键标记点

③直接线性变换(DLT)将二维图像坐标转换为三维空间坐标卷积神经网络(CNN)

k-近邻算法(kNN)位移误差 NR 47% < 20 mm

80% < 30 mm

10% > 40 mmLi等[58] (2018) ①高尔夫、棒球

②关键挥杆动作高尔夫:1 343;

棒球:3 363M 职业运动员 1 RGB 30帧/s ①高尔夫挥杆动作前面观

②高尔夫挥杆动作侧面观

③棒球挥杆动作支持向量机(SVM) ①分类精度(CA)

②计算耗时①交叉验证

②80%训练集,10%验证集,10%测试集①分类精度为97%

②平均计算耗时为2.38 msBertasius等[43] (2017) ①篮球

②投篮

动作48 M 美国NCAA联赛职业运动员 1 RGB 100帧/s 10.3 h视频 ①卷积神经网络(CNN)

②循环神经网络(RNN)、长短期记忆(LSTM)F1得分 ①训练数据集:24个视频

②测试数据集:24个视频①篮球特征识别F1得分为0.625

②篮球运动员表现评价模型F1得分为0.793Kasiri等[48] (2017) ①拳击

②6种类型的直拳、勾拳、摆拳14 M 不同重量级的职业拳击手 1 5 m高, 深度摄像头 25帧/s ①605次出拳

②身体部位检测:基于二维倒角距离、深度值和测地线距离的模糊推理方法①主成分分析(PCA)

②随机森林(RF)

③支持向量机(SVM)①混淆矩阵(CM)

②分类精度(CA)留一法交叉验证(LOO-CV) ①分类精度为63.9%

②融合模型分类精度为60.9%Liu等[44] (2017) ①篮球

②智能篮球场视频分析

③投篮动作10 M 业余运动员 1 RGB NR ①476个投篮得分视频

②571个投篮未得分视频①卷积神经网络(CNN)

②隐马尔科夫模型(HMM)

③支持向量机(SVM)分类精度(CA) ①862个视频作为训练集

②185个视频作为测试集处理时间小于45 ms,分类精度达到94.59% Nibali等[54] (2017) ①跳水

②翻转、团身、扭转、倒立入水等动作NR NR 澳大利亚体育学院高水平运动员 1 RGB NR ①训练集:25 h共4 716次跳水动作

②测试集:同一天内的612次跳水动作

③空间定位:完全回归、部分回归、分段和全局约束卷积神经网络(CNN) 分类精度(CA) NR 跳水动作分类精度范围为86.89%~100% Reily等[47] (2017) ①体操

②鞍马常规旋转动作NR M 职业运动员 1 深度摄像头 NR ①10 115帧PNG格式图片

②通过特征描述:轮廓高度和宽度;轮廓两侧的深度值;与前一帧图像的三维坐标对比支持向量机(SVM) 分类精度(CA) NR ①旋转动作分类精度为93.81%

②平滑处理后旋转动作分类精度提升为94.83%Tora等[51] (2017) ①冰球

②传球、射门NR NR 职业运动员 NR NR NR ①美国冰球联盟比赛视频

②2 507个训练视频

③250个测试视频卷积神经网络(CNN) ①分类精度(CA)

②混淆矩阵(CM)NR 总体分类精度为49.2% Victor等[57] (2017) ①游泳、网球

②仰泳、蛙泳、蝶泳、自由泳4种泳姿

③网球击球动作游泳:40

网球:4NR 职业运动员 NR RGB 游泳:50帧/s

网球:30帧/s①1.5万次游泳划水动作视频

②1 300次网球击球动作视频基于VGG-B架构的卷积神经网络(CNN) F1得分 ①80%训练数据集

②20%测试数据集①游泳F1得分为0.922

②网球F1得分为0.977Ibrahim等[55] (2016) ①排球

②6堂团体训练课

③7名运动员个人动作捕捉NR NR 职业运动员 NR NR NR ①15个YouTube排球训练视频

②1 525帧带注解的图像①卷积神经网络(CNN)

②循环神经网络(RNN)、长短期记忆(LSTM)①分类精度(CA)

②混淆矩阵(CM)①2/3数据作为训练集

②1/3数据作为测试集分类精度为51.1% Ramanathan等[45] (2016) ①篮球

②11场篮球比赛,关键运动员检测NR M 美国NCAA篮球联赛职业运动员 NR NR NR ①257个YouTube篮球比赛视频

②训练集视频4 572 s

③验证集视频3 424 s

④测试集视频9 024 s循环神经网络(RNN),包括长短期记忆(LSTM)和双向长短期记忆(BLSTM) 分类精度(CA) 通过在验证数据集上进行交叉验证选择超参数(hyper-parameters) ①事件平均分类精度为51.6%

②事件检测分类精度为43.5%

③运动员识别分类精度为61.8%Kasiri-Bidhendi等[49] (2015) ①拳击

②6种类型的直拳、勾拳、摆拳8 M 职业拳击手 1 5 m高,深度摄像头 25帧/s ①共192次出拳

②每种类型的出拳为32次

③身体部位识别:基于二维倒角距离和测地线距离的模糊推理方法

④提取每次出拳的时空参数特征①随机森林(RF)

②支持向量机(SVM)①分类精度(CA)

②混淆矩阵(CM)①7名受试者作为训练集

②1名受试者作为测试集

③留一法交叉验证(LOO-CV)分类精度为92%~96% Hachaj等[56](2015) ①空手道

②10种动作:4种防御类,3种踢腿类,3种站立类6 M 顶尖运动员 1 RGB 30帧/s 对1 236次空手道相关动作进行关节角度识别 隐马尔可夫模型(HMM) ①分类精度(CA)

②混淆矩阵(CM)留一法交叉验证(LOO-CV) 总体分类精度为93% Montoliu等[53] (2015) ①足球

②包括控球、定位球和快速进攻NR M 西班牙职业足球运动员 16 RGB 25帧/s ①2场全场足球比赛

②所有图像通过算法组合覆盖足球全场①k-近邻算法(kNN)

②多层感知器算法(MLP)分类精度(CA) ①留一法交叉验证(LOO-CV)

②5层交叉验证分类精度为92.89%±0.2% Díaz⁃Pereira等[46] (2014) ①体操

②10个动作,分为跳跃、旋转、技巧8 F 青少年运动员 1 RGB 25帧/s 560个视频 ①主成分分析(PCA)

②线性判别分析(LDA)

③k-近邻算法(kNN)①灵敏度

②特征识别度10层交叉验证 ①总体灵敏度为90%

②总体特征识别度为85%Karpathy等[60] (2014) 多种竞技运动组合 NR NR 职业运动员 NR NR NR ①110万个YouTube源视频

②随机抽样170×170个视频区域

③每个视频区域包含200×200个像素卷积神经网络(CNN) ①分类精度(CA)

②混淆矩阵(CM)①70%数据作为训练集

②10%数据作为验证集

③20%数据作为测试集分类精度为60.9% Couceiro等[52] (2013) ①高尔夫

②运动员推杆动作6 M 职业运动员 1 RGB 210帧/s ①180次推杆动作

②每名运动员30次①达尔文粒子群优化方法(DPSOM)

②线性判别分析(LDA)混淆矩阵(CM) NR 最小二乘支持向量机(LS-SVM) 总体表现最佳 O′Conaire等[42] (2010) ①网球

②发球、正手击球和反手击球动作5 M 职业运动员 9 RGB NR 基于背景减影和图像形态提取运动员轮廓特征 ①支持向量机(SVM)

②k-近邻算法(kNN)分类精度(CA) 留一法交叉验证(LOO-CV) ①后面观分类精度为98.67%

②侧面观分类精度为95%Lu等[50](2009) ①冰球

②各个方向滑冰运动NR M NR NR RGB NR 5 069张32×32的灰度图像

结合主成分降维分析的多目标跟踪主成分分析(PCA) ①分类精度(CA)

②平均计算耗时

③混淆矩阵(CM)NR ①分类精度为76.37%

②图像识别平均耗时0.206 sRosenhahn等[59] (2008) ①自行车

②单板滑雪

③运动员与装备交互的建模和无标记跟踪2 M NR 7 RGB 100帧/s ①室内功率自行车足部固定骑行

②虚拟现实技术模拟单板滑雪上坡、下坡及跳跃动作支持向量机(SVM) 位移误差 NR 位移误差小于5 mm Shah等[41] (2007) ①网球

②正手击球、反手

击球NR M/F NR NR RGB NR ①150场网球比赛

②每场比赛压缩为

10 min

③采用全局自适应阈值法进行图像分割和权值计算

④基于二进制图像的运动员骨架直方图基于径向基函数的支持向量机(SVM) ①分类精度(CA)

②混淆矩阵(CM)NR ①正手击球分类精度为97.24%

②反手击球分类精度为96.42%Zhu等 [40] (2006) ①网球

②正手击球、反手

击球NR NR 职业运动员 NR RGB NR ①6 035帧图像

②1 099次左侧击球,

1 071次右侧击球

③采用粒子滤波和支持向量回归算法进行运动员追踪识别支持向量机(SVM) ①精确度

②再测精度NR ①左侧击球捕捉精确度为89.80%

②右侧击球捕捉精确度为84.66%

③左侧击球再测精度为84.08%

④右侧击球再测精度为90.20%Liao等[61] (2003) ①游泳

②自由泳、蝶泳、蛙泳、仰泳NR NR 职业运动员 NR RGB NR ①50个比赛视频

②采用启发式阈值分割方法识别运动员上半身动作逻辑回归分析(LR)

决策树(DT)基于特定泳姿开发的评分系统 NR NR 注:RGB(Red,Green,Blue)=三原色光模式;帧/s=每秒传输帧数;PNG(Portable Network Graphics)=便携式网络图形;LSTM(Long Short Term Memory)=长短期记忆;CNN(Convolutional Neural Network)=卷积神经网络;kNN(k-Nearest Neighbour)=k-近邻算法;RNN(Recurrent Neural Network)=循环神经网络;HMM(Hidden Markov Model)=隐马尔科夫模型;LOO-CV(Leave-One-Out Cross Validation)=留一法交叉验证;SVM(Support Vector Machine)=支持向量机;LS-SVM(Least Squares Support Vector Machine)=最小二乘支持向量机;RF(Random Forests)=随机森林算法;ROC(Receiver Operation Characteristic Curve)=接收者操作特征曲线;DPSOM(Darwinian Particle Swarm Optimization Method)=达尔文粒子群优化算法;LR(Logistic Regression)=逻辑回归分析;MLP(Multilayer Perceptron)=多层感知器;CA(Classification Accuracy)=分类精度;CM(Confusion Matrix)=混淆矩阵;M(Male)=男,F(Femal)=女,NR(Not Reported)=未报告。 -

[1] 顾耀东, 孙冬, 梅齐昌. 大数据和人工智能背景下运动鞋生物力学研发思路及启示[J]. 上海体育学院学报, 2021, 45(2): 64 https://styb.cbpt.cnki.net/WKE/WebPublication/paperDigest.aspx?paperID=a9cb3a83-28a4-4add-b8d1-c8814c3cf9ed [2] CIMOLIN V, GALLI M. Summary measures for clinical gait analysis: A literature review[J]. Gait Posture, 2014, 39(4): 1005-1010 doi: 10.1016/j.gaitpost.2014.02.001

[3] STEIN M, JANETZKO H, LAMPRECHT A, et al. Bring it to the pitch: Combining video and movement data to enhance team sport analysis[J]. IEEE T Vis Comput Gr, 2018, 24(1): 13-22 doi: 10.1109/TVCG.2017.2745181

[4] SCHMOLZER B, MÜLLER W. Individual flight styles in ski jumping: Results obtained during Olympic Games competitions[J]. J Biomech, 2005, 38(5): 1055-1065 doi: 10.1016/j.jbiomech.2004.05.038

[5] GÖPFERT C, POHJOLA M V, LINNAMO V, et al. Forward acceleration of the centre of mass during ski skating calculated from force and motion capture data[J]. Sport Eng, 2017, 20(2): 141-153 doi: 10.1007/s12283-016-0223-9

[6] NUNOME H, INOUE K, WATANABE K, et al. Dynamics of submaximal effort soccer instep kicking[J]. J Sports Sci, 2018, 36(22): 2588-2595 doi: 10.1080/02640414.2018.1470216

[7] GASTIN P B, MCLEAN O C, BREED R V P, et al. Tackle and impact detection in elite Australian football using wearable microsensor technology[J]. J Sports Sci, 2014, 32(10): 947-953 doi: 10.1080/02640414.2013.868920

[8] GABBETT T J, JENKINS D G, ABERNETHY B. Physical demands of professional rugby league training and competition using microtechnology[J]. J Sci Med Sport, 2012, 15(1): 80-86 doi: 10.1016/j.jsams.2011.07.004

[9] MOONEY R, CORLEY G, GODFREY A, et al. Inertial sensor technology for elite swimming performance analysis: A systematic review[J]. Sensors, 2015, 16(1): 18 doi: 10.3390/s16010018

[10] YU G, JANG Y J, KIM J, et al. Potential of IMU sensors in performance analysis of professional alpine skiers[J]. Sensors, 2016, 16(4): 463 doi: 10.3390/s16040463

[11] WIXTED A J, BILLING D C, JAMES D A. Validation of trunk mounted inertial sensors for analysing running biomechanics under field conditions, using synchronously collected foot contact data[J]. Sport Eng, 2010, 12(4): 207-212 doi: 10.1007/s12283-010-0043-2

[12] NAKANO N, SAKURA T, UEDA K, et al. Evaluation of 3D markerless motion capture accuracy using openpose with multiple video cameras[J]. Front Sport Act Living, 2020, 2: 1-9 http://www.researchgate.net/publication/341677423_Evaluation_of_3D_Markerless_Motion_Capture_Accuracy_Using_OpenPose_With_Multiple_Video_Cameras

[13] CHEN C H, RAMANAN D. 3D human pose estimation=2D pose estimation+matching[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Honolulu: IEEE/CVF, 2017: 7035-7043

[14] ISKAKOV K, BURKOV E, LEMPITSKY V, et al. Learnable triangulation of human pose[C]//Proceedings of the IEEE/CVF International Conference on Computer Vision(ICCV). Seoul: IEEE/CVF, 2019: 7718-7727

[15] COLYER S L, EVANS M, COSKER D P, et al. A review of the evolution of vision-based motion analysis and the integration of advanced computer vision methods towards developing a markerless system[J]. Sport Med, 2018, 4(1): 1-15 doi: 10.1186/s40798-018-0139-y

[16] PAVLLO D, FEICHTENHOFER C, GRANGIER D, et al. 3D human pose estimation in video with temporal convolutions and semi-supervised training[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Long Beach: IEEE/CVF, 2018: 7753-7762

[17] CUST E E, SWEETING A J, BALL K, et al. Machine and deep learning for sport-specific movement recognition: A systematic review of model development and performance[J]. J Sports Sci, 2019, 37(5): 568-600 doi: 10.1080/02640414.2018.1521769

[18] THOMAS G, GADE R, MOESLUND T B, et al. Computer vision for sports: Current applications and research topics[J]. Comput Vis Image Underst, 2017, 159: 3-18 doi: 10.1016/j.cviu.2017.04.011

[19] YANG J B, NGUYEN M N, SAN P P, et al. Deep convolutional neural networks on multichannel time series for human activity recognition[C]//Proceedings of the Twenty-Fourth International Joint Conference on Artificial Intelligence. Buenos Aires, 2015: 3995-4001

[20] 梅齐昌, 顾耀东, 孙冬, 等. 基于影像学构建个体化OpenSim下肢肌骨模型的生物力学研究应用进展[J]. 医用生物力学, 2020, 35(2): 259-264 https://www.cnki.com.cn/Article/CJFDTOTAL-YISX202002021.htm [21] 孙冬, 赵亮, 黄莹, 等. 运动生物力学视角下残疾人体育竞技表现提升研究进展[J]. 体育科学, 2020, 40(5): 60-72 https://www.cnki.com.cn/Article/CJFDTOTAL-TYKX202005006.htm [22] SEETHAPATHI N, WANG S, SALUJA R, et al. Movement science needs different pose tracking algorithms[EB/OL]. [2021-06-27]. https://arxiv.org/abs/1907.10226

[23] KAUTZ T, GROH B H, HANNINK J, et al. Activity recognition in beach volleyball using a deep convolutional neural network: Leveraging the potential of deep learning in sports[J]. Data Min Knowl Disc, 2017, 31(6): 1678-1705 doi: 10.1007/s10618-017-0495-0

[24] BUX A, ANGELOV P, HABIB Z. Vision based human activity recognition: A review[M]//ANGELOV P, GEGOV A, JAYNE C, et al. Advances in computational intelligence systems. Cham: Springer, 2017: 341-371

[25] GASTIN P B, MCLEAN O, SPITTLE M, et al. Quantification of tackling demands in professional Australian football using integrated wearable athlete tracking technology[J]. J Sci Med Sport, 2013, 16(6): 589-593 doi: 10.1016/j.jsams.2013.01.007

[26] WUNDERSITZ D W T, GASTIN P B, RICHTER C, et al. Validity of a trunk-mounted accelerometer to assess peak accelerations during walking, jogging and running[J]. Eur J Sport Sci, 2015, 15(5): 382-390 doi: 10.1080/17461391.2014.955131

[27] PREECE S J, GOULERMAS J Y, KENNEY L P J, et al. A comparison of feature extraction methods for the classification of dynamic activities from accelerometer data[J]. IEEE Trans Biomed Eng, 2009, 56(3): 871-879 doi: 10.1109/TBME.2008.2006190

[28] KAPELA R, ŚWIETLICKA A, RYBARCZYK A, et al. Real-time event classification in field sport videos[J]. Signal Process: Image Communication, 2015, 35: 35-45 doi: 10.1016/j.image.2015.04.005

[29] ZHANG S G, WEI Z Q, NIE J, et al. A review on human activity recognition using vision-based method[J]. J Healthc Eng, 2017(3): 1-31 http://downloads.hindawi.com/journals/jhe/2017/3090343.pdf

[30] LECUN Y, BENGIO Y, HINTON G. Deep learning[J]. Nature, 2015, 521(7553): 436-444 doi: 10.1038/nature14539

[31] SZE V, CHEN Y H, YANG T J, et al. Efficient processing of deep neural networks: A tutorial and survey[J]. Proceedings of IEEE, 2017, 105(12): 2295-2329 doi: 10.1109/JPROC.2017.2761740

[32] RAV D, WONG C, LO B, et al. A deep learning approach to on-node sensor data analytics for mobile or wearable devices[J]. IEEE J Biomed Heal Informatics, 2017, 21(1): 56-64 doi: 10.1109/JBHI.2016.2633287

[33] RONAO C A, CHO S B. Human activity recognition with smartphone sensors using deep learning neural networks[J]. Expert Syst Appl, 2016, 59: 235-244 doi: 10.1016/j.eswa.2016.04.032

[34] ZEBIN T, SCULLY P J, OZANYAN K B. Human activity recognition with inertial sensors using a deep learning approach[C]//Proceedings of 2016 IEEE Sensors. Orlando: IEEE, 2016: 1-3

[35] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. Imagenet classification with deep convolutional neural networks[J]. Commun ACM, 2012, 25: 1097-1105 http://web.cs.ucdavis.edu/~yjlee/teaching/ecs289g-winter2018/alexnet.pdf

[36] JI S W, XU W, YANG M, et al. 3D convolutional neural networks for human action recognition[J]. IEEE Trans Pattern Anal Mach Intell, 2013, 35(1): 221-231 doi: 10.1109/TPAMI.2012.59

[37] AGGARWAL J K, XIA L. Human activity recognition from 3D data: A review[J]. Pattern Recognit Lett, 2014, 48: 70-80 doi: 10.1016/j.patrec.2014.04.011

[38] KE S R, THUC H L U, LEE Y J, et al. A review on videobased human activity recognition[J]. Computers, 2013, 2(2): 88-131 doi: 10.3390/computers2020088

[39] MOHER D, SHAMSEER L, CLARKE M, et al. Preferred reporting items for systematic review and meta-analysis protocols (PRISMA-P) 2015 statement[J]. Systematic Reviews, 2015, 4(1): 1-9 doi: 10.1186/2046-4053-4-1

[40] ZHU G Y, XU C S, HUANG Q M, et al. Action recognition in broadcast tennis video[C]//18th International Conference on Pattern Recognition (ICPR'06). Hong Kong: IEEE, 2006: 251-254

[41] SHAH H, CHOKALINGAM P, PALURI B, et al. Automated stroke classification in tennis[C]//International Conference on Image Analysis and Recognition. Montreal, 2007: 1128-1137

[42] Ó CONAIRE C, CONNAGHAN D, KELLY P, et al. Combining inertial and visual sensing for human action recognition in tennis[C]//Proceedings of the First ACM International Workshop on Analysis and Retrieval of Tracked Events and Motion in Imagery Streams. Firenze: SIGMM, 2010: 51-56

[43] BERTASIUS G, PARK H S, YU S X, et al. Am I a baller? Basketball skill assessment using first-person cameras[C]//Proceedings of the IEEE International Conference on Computer Vision(ICCV). Venice: IEEE, 2017: 2177-2185

[44] LIU W, YAN C C, LIU J Y, et al. Deep learning based basketball video analysis for intelligent arena application[J]. Multimed Tools Appl, 2017, 76(23): 24983-25001 doi: 10.1007/s11042-017-5002-5

[45] RAMANATHAN V, HUANG J, ABU-EL-HAIJA S, et al. Detecting events and key actors in multi-person videos[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Las Vegas: IEEE/CVF, 2016: 3043-3053

[46] DÍAZ-PEREIRA M P, GÓMEZ-CONDE I, ESCALONA M, et al. Automatic recognition and scoring of Olympic rhythmic gymnastic movements[J]. Hum Mov Sci, 2014, 34: 63-80 doi: 10.1016/j.humov.2014.01.001

[47] REILY B, ZHANG H, HOFF W. Real-time gymnast detection and performance analysis with a portable 3D camera[J]. Comput Vis Image Underst, 2017, 159: 154-163 doi: 10.1016/j.cviu.2016.11.006

[48] KASIRI S, FOOKES C, SRIDHARAN S, et al. Finegrained action recognition of boxing punches from depth imagery[J]. Comput Vis Image Underst, 2017, 159: 143-153 doi: 10.1016/j.cviu.2017.04.007

[49] KASIRI-BIDHENDI S, FOOKES C, MORGAN S, et al. Combat sports analytics: Boxing punch classification using overhead depthimagery[C]//2015 IEEE International Conference on Image Processing(ICIP). Quebec: IEEE, 2015: 4545-4549

[50] LU W L, OKUMA K, LITTLE J J. Tracking and recognizing actions of multiple hockey players using the boosted particle filter[J]. Image Vis Comput, 2009, 27(1-2): 189-205 doi: 10.1016/j.imavis.2008.02.008

[51] TORA M R, CHEN J H, LITTLE J J. Classification of puck possession events in ice hockey[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition Workshops(CVPRW). Honolulu: IEEE, 2017: 147-154

[52] COUCEIRO M S, DIAS G, MENDES R, et al. Accuracy of pattern detection methods in the performance of golf putting[J]. J Mot Behav, 2013, 45(1): 37-53 doi: 10.1080/00222895.2012.740100

[53] MONTOLIU R, MARTÍN-FÉLEZ R, TORRESSOSPEDRA J, et al. Team activity recognition in Association Football using a Bag-of-Words-based method[J]. Hum Mov Sci, 2015, 41: 165-178 doi: 10.1016/j.humov.2015.03.007

[54] NIBALI A, HE Z, MORGAN S, et al. Extraction and classification of diving clips from continuous video footage[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR) Workshops. Honolulu: IEEE/CVF, 2017: 38-48

[55] IBRAHIM M S, MURALIDHARAN S, DENG Z W, et al. A hierarchical deep temporal model for group activity recognition[C]//Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Las Vegas: IEEE/CVF, 2016: 1971-1980

[56] HACHAJ T, OGIELA M R, KOPTYRA K. Application of assistive computer vision methods to oyama karate techniques recognition[J]. Symmetry, 2015, 7(4): 1670-1698 doi: 10.3390/sym7041670

[57] VICTOR B, HE Z, MORGAN S, et al. Continuous video to simple signals for swimming stroke detection with convolutional neural networks[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition Workshops(CVPRW). Honolulu: IEEE/CVF, 2017: 66-75

[58] LI J M, TIAN Q, ZHANG G Y, et al. Research on hybrid information recognition algorithm and quality of golf swing[J]. Comput Electr Eng, 2018, 69: 907-919 doi: 10.1016/j.compeleceng.2018.02.013

[59] ROSENHAHN B, SCHMALTZ C, BROX T. et al. Markerless motion capture of man-machine interaction[C]//2008 IEEE Conference on Computer Vision and Pattern Recognition. Anchorage: IEEE, 2008: 1-8

[60] KARPATHY G, TODERICI G, SHETTY S, et al. Largescale video classification with convolutional neural networks[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Columbus: IEEE/CVF, 2014: 1725-1732

[61] LIAO W H, LIAO Z X, LIU M J. Swimming style classification from video sequences[C]//16th IPPR Conference on Computer Vision, Graphics and Image Processing. Kinmen, 2003: 226-233

[62] EL-SALLAM A, BENNAMOUN, HONDA K, et al. Towards a fully automatic markerless motion analysis system for the estimation of body joint kinematics with application to sport analysis[C]//10th International Conference on Computer Graphics Theory and Applications. Berlin, 2015: 58-69

[63] BOUWMANS T. Traditional and recent approaches in background modeling for foreground detection: An overview[J]. Comput Sci Rev, 2014, 11: 31-66 http://www.researchgate.net/profile/Thierry_BOUWMANS/publication/262077612_Traditional_and_Recent_Approaches_in_Background_Modeling_for_Foreground_Detection_An_Overview/links/59ed7a93a6fdccef8b0dcb93/Traditional-and-Recent-Approaches-in-Background-Modeling-for-Foreground-Detection-An-Overview.pdf

[64] YE M, ZHANG Q, WANG L, et al. A survey on human motion analysis from depth data[M]//GRZEGORZEK M, THEOBALT C, KOCH R, et al. Time-of-flight depth imaging. Sensors, algorithms, application. Berlin, Heidelberg: Springer, 2013: 149-187

[65] WANG Q F, KURILLO G, OFLI F, et al. Evaluation of pose tracking accuracy in the first and second generations of microsoft kinect[C]//Proceedings of the IEEE International Conference on Healthcare Informatics, ICHI 2015. Dallas: IEEE, 2015: 380-389

[66] STOLL C, HASLER N, GALL J, et al. Fast articulated motion tracking using a sums of Gaussians body model[C]//Proceedings of the IEEE International Conference on Computer Vision. Barcelona: IEEE, 2011: 951-958

[67] EL-SALLAM A, BENNAMOUN M, SOHEL F, et al. A low cost 3D markerless system for the reconstruction of athletic techniques[C]//2013 IEEE Workshop on Applications of Computer Vision (WACV). Clearwater Beach: IEEE, 2013: 222-229

[68] ALLEN B, CURLESS B, POPOVIĆ Z. The space of human body shapes: Reconstruction and parameterization from range scans[J]. ACM T Graphic, 2003, 22(3): 587-594 doi: 10.1145/882262.882311

[69] ANGUELOV P, SRINIVASAN P, KOLLER D, et al. SCAPE: Shape completion and animation of people dragomir[C]//Special Interest Group on Computer Graphics and Interactive Techniques Conference. Los Angeles: SIGGRAPH, 2005: 408-416

[70] 梅齐昌, 高自翔, FERNANDEZ J, 等. 基于统计形状模型的三维足形状建模[J]. 医用生物力学, 2021, 36(1): 96-101 https://www.cnki.com.cn/Article/CJFDTOTAL-YISX202101017.htm [71] LOPER M, MAHMOOD N, ROMERO J, et al. SMPL: A skinned multi-person linear model[J]. ACM T Graphic, 2015, 34(6): 1-16 doi: 10.1145/2816795.2818013

[72] AKHTER I, BLACK M J. Pose-conditioned joint angle limits for 3D human pose reconstruction[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Boston: IEEE/CVF, 2015: 1446-1455

[73] HOLDEN D, SAITO J, KOMURA T, et al. Learning motion manifolds with convolutional autoencoders[C]//Special Interest Group on Computer Graphics Asia 2015. Kobe: SIGGRAPH, 2015: 1-4

[74] HASLER N, ROSENHAHN B, THORMAHLEN T, et al. Markerless motion capture with unsynchronized moving cameras[C]//2009 IEEE Conference on Computer Vision and Pattern Recognition. Miami: IEEE, 2009: 224-231

[75] CORAZZA S, MÜNDERMANN L, GAMBARETTO E, et al. Markerless motion capture through visual hull, articulated ICP and subject specific model generation[J]. Int J Comput Vis, 2010, 87(1-2): 156-169 doi: 10.1007/s11263-009-0284-3

[76] KANAUJIA A, KITTENS N, RAMANATHAN N. Part segmentation of visual hull for 3D human pose estimation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR) Workshops. Portland: IEEE/CVF, 2013: 542-549

[77] LIU Y B, GALL J, STOLL C, et al. Markerless motion capture of multiple characters using multiview image segmentation[J]. IEEE T Pattern Anal Mach Intell, 2013, 35(11): 2720-2735 doi: 10.1109/TPAMI.2013.47

[78] ELHAYEK A, DE AGUIAR E, JAIN A, et al. Efficient convnet-based marker-less motion capture in general scenes with a low number of cameras[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Boston: IEEE/CVF, 2015: 3810-3818

[79] YU Q, DINH T B, MEDIONI G. Online tracking and reacquisition using co-trained generative and discriminative trackers[C]//European Conference on Computer Vision. Marseiue, 2008: 678-691

[80] AMIN S, ANDRILUKA M, ROHRBACH M, et al. Multiview pictorial structures for 3D human pose estimation[C]//Proceedings of the 24th British Machine Vision Conference. Bristol, 2013: 1-12

[81] SAINI S, ZAKARIA N, RAMBLI D R A, et al. Markerless human motion tracking using hierarchical multi-swarm cooperative particle swarm optimization[J]. PLoS One, 2015, 10(5): 1-22 http://journals.plos.org/plosone/article/file?id=10.1371/journal.pone.0127833&type=printable

[82] ZHAO X, LIU Y C. Generative tracking of 3D human motion by hierarchical annealed genetic algorithm[J]. Pattern Recognition, 2008, 41(8): 2470-2483 doi: 10.1016/j.patcog.2008.01.004

[83] SMINCHISESCU C, KANAUJIA A, LI Z, et al. Discriminative density propagation for 3D human motion estimation[C]//2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition(CVPR'05). San Diego: IEEE, 2005: 390-397

[84] BELAGIANNIS V, AMIN S, ANDRILUKA M, et al. 3D pictorial structures for multiple human pose estimation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Columbus: IEEE/CVF, 2014: 1669-1676

[85] CORAZZA S, MÜNDERMANN L, CHAUDHARI A M, et al. A markerless motion capture system to study musculoskeletal biomechanics: Visual hull and simulated annealing approach[J]. Ann Biomed Eng, 2006, 34(6): 1019-1029 doi: 10.1007/s10439-006-9122-8

[86] BURENIUS M, SULLIVAN J, CARLSSON S. 3D pictorial structures for multiple view articulated pose estimation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Portland: IEEE/CVF, 2013: 3618-3625

[87] KAZEMI V, BURENIUS M, AZIZPOUR H, et al. Multiview body part recognition with random forests[C]//BMVC 2013-Electronic Proceedings of the British Machine Vision Conference 2013. Bristol: BMVA, 2013: 1-11

[88] RHODIN H, ROBERTINI N, CASAS D, et al. General automatic human shape and motion capture using volumetric contour cues[C]//European Conference on Computer Vision. Amsterdam, 2016: 509-526

[89] HONG C Q, YU J, YONG X, et al. Multi-view deep learning for image-based pose recovery[C]//2015 IEEE 16th International Conference on Communication Technology (ICCT). Hangzhou: IEEE/CVF, 2015: 897-902

[90] MINNEN D, WESTEYN T, STARNER T, et al. Performance metrics and evaluation issues for continuous activity recognition[J]. Perform Metrics Intell Syst, 2006, 4: 141-148 http://citeseerx.ist.psu.edu/viewdoc/summary?doi=10.1.1.118.8352

[91] WARD J A, LUKOWICZ P, GELLERSEN H W. Performance metrics for activity recognition[J]. ACM Trans Intell Syst Technol, 2011, 2(1): 1-23 https://core.ac.uk/download/pdf/110985272.pdf

[92] SEIFFERT C, KHOSHGOFTAAR T M, HULSE J V, et al. RUSBoost: Improving classification performance when training data is skewed[C]//2008 19th International Conference on Pattern Recognition. Tampa: IEEE, 2008: 1-4

[93] WOLPERT D H. The lack of a priori distinctions between learning algorithms[J]. Neural Comput, 1996, 8(7): 1341-1390 doi: 10.1162/neco.1996.8.7.1341

[94] SHALEV-SHWARTZ S, BEN-DAVID S. Understanding machine learning opportunities[M]. New York: Cambridge University Press, 2014: 395

[95] CHAWLA S, ESTEPHAN J, GUDMUNDSSON J, et al. Classification of passes in football matches using spatiotemporal data[J]. ACM Trans Spat Algorithms Syst, 2017, 3(2): 1-30 http://lib-arxiv-008.serverfarm.cornell.edu/pdf/1407.5093v1.pdf

[96] SCHULDHAUS D, ZWICK C, KORGER H, et al. Inertial sensor-based approach for shot/pass classification during a soccer match[C]//KDD Workshop on Large-Scale Sports Analytics. Sydney, 2015: 1-4

-

期刊类型引用(20)

1. 王之若,杨云添. AIGC赋能电影虚拟角色的影像生产力——基于计算机图形技术的考察. 中国电影市场. 2025(01): 47-54 .  百度学术

百度学术

2. 柳金辉. 运动捕捉技术在三维动画设计中的应用及发展前景. 济宁学院学报. 2024(01): 90-95 .  百度学术

百度学术

3. 叶晓东,李凯,芦伟. 巴黎奥运周期我国竞技体操备战探索. 中国体育教练员. 2024(01): 23-25+45 .  百度学术

百度学术

4. 朱琳,董鹏程,沈培鑫,陈浩,孙建德,宋祺鹏. 基于SGGC-Net动作捕捉系统解析行走步态的信度与效度. 医用生物力学. 2024(02): 305-311 .  百度学术

百度学术

5. 王景,刘利新. 人工智能技术在黑龙江高校冰雪运动中的应用与优化路径. 冰雪体育创新研究. 2024(08): 170-172 .  百度学术

百度学术

6. 陈柯行,孟令飞,Daniel Memmert. 人工智能引领运动训练发展的现实需求、域外经验及中国方案. 体育科学. 2024(04): 3-15 .  百度学术

百度学术

7. 顾耀东,汪顺,徐异宁. 巴黎奥运周期竞技游泳运动生物力学研究进展. 医用生物力学. 2024(04): 576-585 .  百度学术

百度学术

8. 徐静. 基于感知学习算法的啦啦操动作风格识别与性能分析. 景德镇学院学报. 2024(03): 48-52 .  百度学术

百度学术

9. 龚威,王结春. 面向体育运动训练指导的视频动作卷积分割方法. 安阳工学院学报. 2024(06): 117-122 .  百度学术

百度学术

10. 陈超,宋金庄,何胜保. 信息技术与高校短跑教学深度融合的理论与实践. 体育科技文献通报. 2023(01): 136-137+154 .  百度学术

百度学术

11. 李敬凯. 人工智能背景下运动生物力学的研究进展与趋势. 中国皮革. 2023(01): 70-72 .  百度学术

百度学术

12. 刘文萍,李影. 基于图像识别的啦啦操上臂动作误差识别方法. 沧州师范学院学报. 2023(01): 106-112 .  百度学术

百度学术

13. 孟莉. 基于虚拟现实技术的三维体育辅助训练系统设计. 兰州工业学院学报. 2023(02): 78-82+98 .  百度学术

百度学术

14. 王云鹏,吕诗雨,司海平,孙昌霞,王翾. 基于人体骨架的国标舞蹈动作相似度计算研究. 电子设计工程. 2023(11): 10-15 .  百度学术

百度学术

15. 宋杨,孙冬,岑炫震,BíRó István,顾耀东. 个体化足-鞋耦合有限元建模及在跖骨应力研究中的应用. 应用力学学报. 2023(05): 1204-1212 .  百度学术

百度学术

16. 李徐梅. 基于人工智能的计算机视觉技术研究. 信息与电脑(理论版). 2022(05): 147-149 .  百度学术

百度学术

17. 张马森,曲毅,崔婧,刘卉. 运动捕捉人工智能系统在速滑项目中的应用. 科学技术与工程. 2022(14): 5674-5680 .  百度学术

百度学术

18. 黄凯宁. 计算机视觉技术对智能交通系统发展的促进作用. 黄河科技学院学报. 2022(08): 59-63 .  百度学术

百度学术

19. 王丕坤,孙倩,刘毅,马宏伟,高永艳,杨东强. 基于特征工程和深度学习方法估算体力消耗的模型有效性研究. 上海体育学院学报. 2022(10): 52-64 .  百度学术

百度学术

20. 徐大涛,全文静,周辉宇,孙冬,Julien S.BAKER,顾耀东. 基于深度神经网络和逐层相关性传播技术探究“高-低”里程跑者步态模式差异. 医用生物力学. 2022(06): 1151-1157+1164 .  百度学术

百度学术

其他类型引用(9)

下载:

下载: